ChatBox / Cherry Studio 接入 Claude API 完整教程(实测数据)

不是所有人都想写代码调 API——很多时候你只是想找一个好用的桌面客户端,直接和 Claude 聊天、写文档、改代码、分析文件。

ChatBox 和 Cherry Studio 是目前国内最受欢迎的两款 AI 桌面客户端,都支持自定义 API 接入。本文教你用 (https://claudeapi.com) 的 API,在这两个客户端中国内直连接入 Claude 全系列模型——支持微信/支付宝充值、3 分钟搞定。

📌 本文所有数据均为 2026 年 4 月 2 日实测,使用 OpenAI 兼容格式(

https://claudeapi.com),国内网络直连,无 VPN。

获取 Claude API Key(前置准备)

在配置客户端之前,你需要先有一个可用的 API Key。

通过 https://code0.ai 获取,3 步搞定:

- 注册账号:访问(https://claudeapi.com)

- 充值余额:支付宝/微信支付,注册就送5元体验,完全足够跑通全流程。

- 获取 key:控制台 → 令牌管理 → 添加新令牌 → 复制保存

💡 更详细的注册流程请参考:Claude API 价格与模型选择指南

拿到 Key 后,记住关键配置:

| 用途 | Base URL | 说明 |

|---|---|---|

| OpenAI 兼容格式/Anthropic | https://gw.claudeapi.com |

ChatBox、Cherry Studio 等客户端用这个 |

💡 ChatBox 和 Cherry Studio 都通过 OpenAI 兼容格式/Anthropic接入,Base URL 统一填

https://gw.claudeapi.com。国内直连,无需任何代理。

Claude 模型实测数据(5 个模型全部验证通过)

在配置客户端之前,我们先用 OpenAI 兼容格式实测所有可用模型,让你对每个模型的速度和用量有真实的预期。

测试条件

- 测试时间:2026 年

- 网络环境:国内网络直连

- API 格式:OpenAI 兼容(

https://gw.claudeapi.com) - 测试方式:Python OpenAI SDK

- 测试 Prompt:

"介绍 Python 的优点。"(max_tokens=200)

五模型响应速度与 Token 用量实测

| 模型 | Model ID | 响应耗时 | 输入 Token | 输出 Token | 状态 |

|---|---|---|---|---|---|

| Claude Sonnet 4.6 | claude-sonnet-4-6 |

8.35s | 22 | 200 | ✅ 通过 |

| Claude Opus 4.6 | claude-opus-4-6 |

7.01s | 22 | 200 | ✅ 通过 |

| Claude Haiku 4.5 | claude-haiku-4-5-20251001 |

4.03s | 22 | 180 | ✅ 通过 |

| Claude Sonnet 4.5 | claude-sonnet-4-5-20250929 |

4.63s | 22 | 148 | ✅ 通过 |

| Claude Sonnet 4 | claude-sonnet-4-20250514 |

6.85s | 22 | 200 | ✅ 通过 |

💡 Haiku 4.5 最快(4.03s),适合简单任务和批量处理。日常用 Sonnet 4.6 性价比最优。了解各模型详细定价,请参考 Claude API 价格与模型选择指南。

流式输出实测

使用 stream=True 测试流式输出:

| 指标 | 实测结果 |

|---|---|

| 模型 | claude-sonnet-4-6 |

| Prompt | "用一句话介绍你自己" |

| 首 Token 延迟 | 5.38s |

| 总耗时 | 7.16s |

| Chunk 数 | 13 |

| 回复内容 | “我是由Anthropic训练的AI助手Claude,致力于以安全、诚实和有益的方式回答您的问题和协助完成各种任务。” |

流式输出正常工作,在 ChatBox / Cherry Studio 中会看到回复逐字显示。

多轮对话实测

测试带 System Prompt 的 3 轮连续对话:

| 轮次 | 用户问题 | Claude 回复 | 耗时 |

|---|---|---|---|

| 第 1 轮 | “Python 的 GIL 是什么?一句话回答。” | “GIL(全局解释器锁)是 CPython 中一个互斥锁,确保同一时刻只有一个线程执行 Python 字节码,从而防止多线程并发访问导致的内存安全问题。” | 11.43s |

| 第 2 轮 | “怎么绕过它?一句话。” | “用 multiprocessing(多进程)替代多线程,或使用 C 扩展/asyncio(I/O 密集型场景)。” | 3.08s |

| 第 3 轮 | “multiprocessing 和 threading 哪个适合 CPU 密集型?” | “multiprocessing——每个进程有独立的 GIL,真正并行利用多核。” | 7.90s |

3 轮对话总耗时 22.41s,上下文连贯,回复准确。

长文本生成实测

| 指标 | 实测结果 |

|---|---|

| Prompt | “写一篇 300 字的短文,主题:为什么程序员应该学习 AI” |

| max_tokens | 1024 |

| 耗时 | 42.22s |

| 输入 Token | 35 |

| 输出 Token | 476 |

| 生成内容长度 | 478 字符 |

ChatBox 接入 Claude API(详细配置步骤)

ChatBox 简介

[ChatBox]是一款开源免费的 AI 桌面客户端,支持 Windows、macOS、Linux、iOS、Android 和网页版,功能包括:

- 多模型对话(GPT、Claude、Gemini 等)

- 文档/图片对话(PDF、Word、代码文件)

- 代码高亮与预览

- Markdown / LaTeX 渲染

- 本地数据存储,隐私安全

- MCP 服务集成

下载安装 ChatBox

前往 chatboxai.app 下载对应平台的安装包:

| 平台 | 版本 |

|---|---|

| Windows | 64-bit 安装包 |

| macOS | Intel 版 / Apple Silicon 版 |

| Linux | 64-bit / ARM64 |

| iOS / Android | App Store / Google Play |

| Web | web.chatboxai.app 在线版 |

ChatBox 配置 Claude API(步骤详解)

第一步:打开设置

启动 ChatBox → 点击左下角 ⚙️ 设置图标

第二步:选择模型提供方

在设置页面中,找到「AI 模型提供方」(AI Provider),选择:

添加模型提供方(OpenAI API 兼容)

第三步:填写 API 配置

| 配置项 | 填什么 | 备注 |

|---|---|---|

| API Host / Base URL | https://gw.claudeapi.com |

|

| API Key | 你的 sk- 开头的 Token |

从 ClaudeAPI.com 控制台获取 |

| Model(模型名称) | claude-sonnet-4-6 |

推荐日常使用 |

第四步:添加模型

点击添加至少一个模型,勾选模型对应的能力配置(可选,不配置视为纯文本模型)

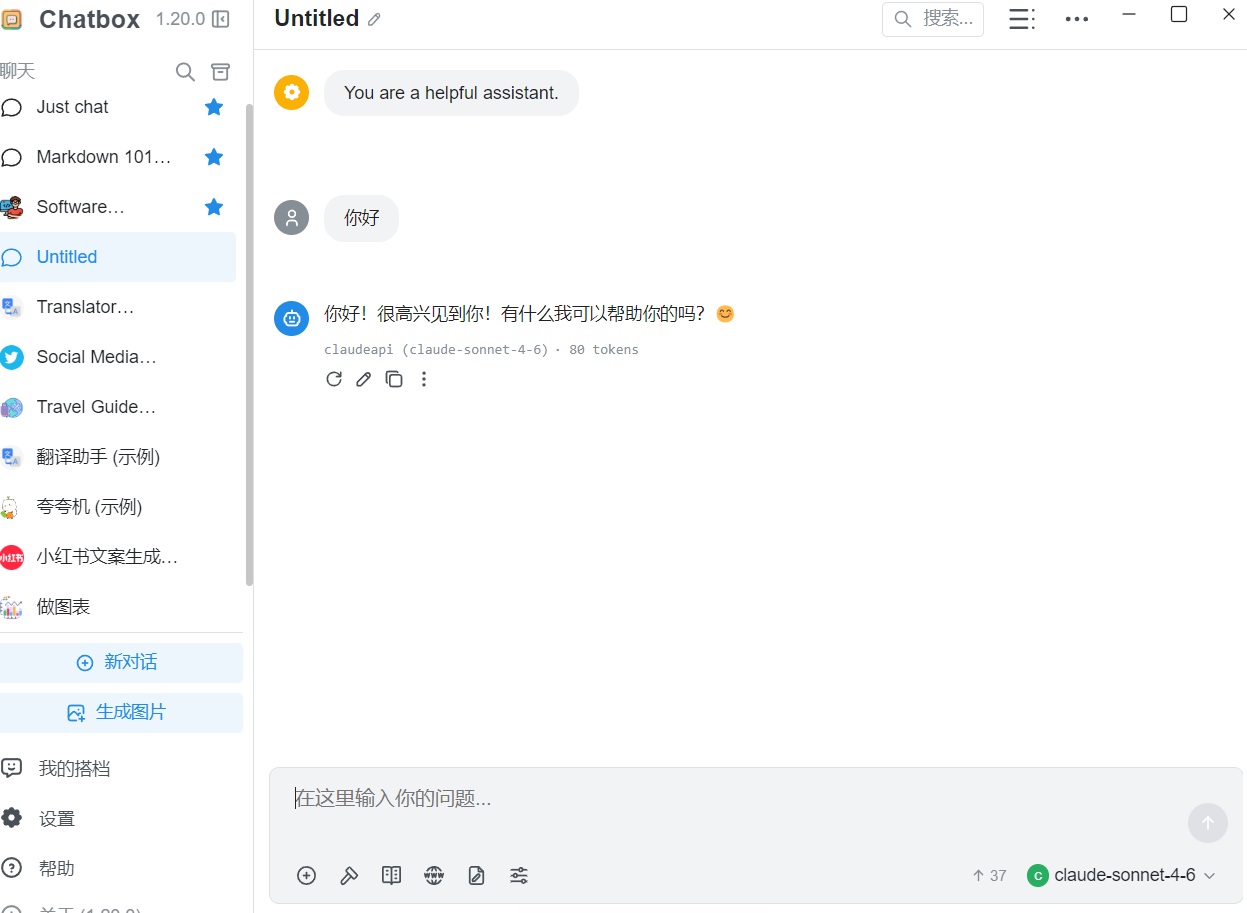

第五步:检查完成之后保存并测试

点击保存,回到对话界面,发送一条消息:

你好,请用一句话介绍你自己

预期收到类似回复:*"你好!很高兴见到你!有什么我可以帮助你的吗?😊

claudeapi (claude-sonnet-4-6)· 80 tokens"*(实测结果)

在 ChatBox 中切换 Claude 模型

在对话界面或设置中,修改模型名称来切换不同模型:

| 想用的模型 | 模型名称填 | 实测响应速度 |

|---|---|---|

| Claude Sonnet 4.6(推荐日常) | claude-sonnet-4-6 |

~8s |

| Claude Opus 4.6(最强推理) | claude-opus-4-6 |

~7s |

| Claude Haiku 4.5(最快最便宜) | claude-haiku-4-5-20251001 |

~4s |

| Claude Sonnet 4.5 | claude-sonnet-4-5-20250929 |

~5s |

| Claude Sonnet 4 | claude-sonnet-4-20250514 |

~7s |

💡 日常聊天写作用 Sonnet 4.6,需要深度分析用 Opus 4.6,简单任务追求速度用 Haiku 4.5。

Cherry Studio 接入 Claude API(详细配置步骤)

Cherry Studio 简介

[Cherry Studio] 是一款国产开源 AI 桌面客户端,支持 Windows、macOS、Linux,特点包括:

- 集成 300+ AI 模型,兼容 50+ AI 服务商

- 300+ 内置智能助手

- 知识库、AI 绘图、翻译

- 支持 Ollama / LM Studio 本地模型

- 完全免费开源

下载安装 Cherry Studio

前往 cherry-ai.com/download 下载对应平台版本。

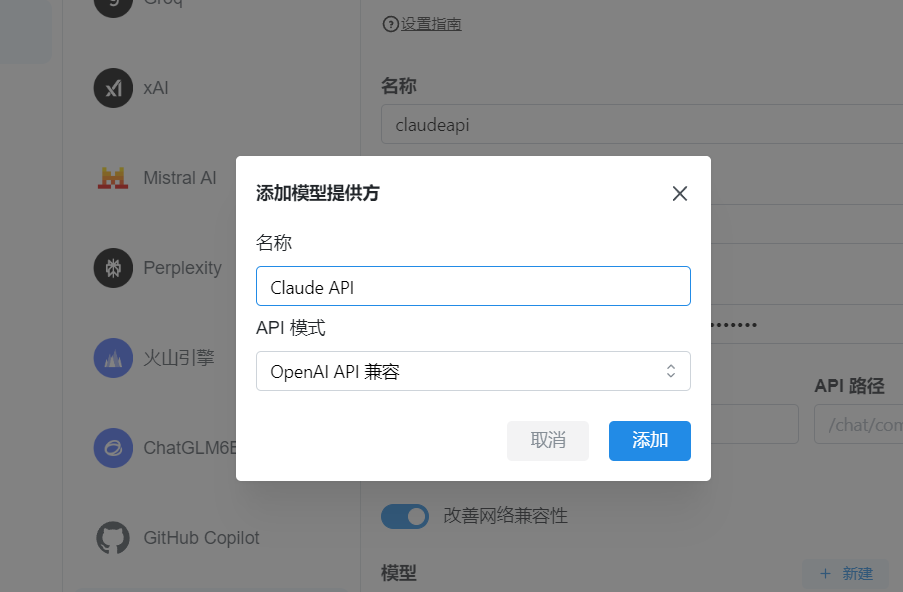

Cherry Studio 配置 Claude API(步骤详解)

第一步:打开设置

启动 Cherry Studio → 点击左侧边栏 设置(齿轮图标)

第二步:添加自定义服务商

在设置页面中,找到「模型服务」或「服务商管理」:

- 点击「添加服务商」

- 选择 OpenAI 或 Anthropic

- 填写服务商名称,如

ClaudeAPI

第三步:填写 API 配置

| 配置项 | 填什么 | 备注 |

|---|---|---|

| API 地址 / Base URL | https://gw.claudeapi.com |

|

| API 密钥 / API Key | 你的 sk- 开头的 Token |

从 https://gw.claudeapi.com 控制台获取 |

第四步:添加模型

配置好服务商后,需要手动添加你要使用的模型:

- 在 ClaudeAPI 服务商下,点击「添加模型」

- 输入模型 ID:

claude-sonnet-4-6 - 可以继续添加其他模型:

claude-opus-4-6claude-haiku-4-5-20251001claude-sonnet-4-5-20250929claude-sonnet-4-20250514

第五步:开始对话

- 回到对话界面

- 在模型选择器中切换到 ClaudeAPI 服务商

- 选择

claude-sonnet-4-6模型 - 发送消息测试

💡 Cherry Studio 支持在同一个对话中切换不同模型,方便对比回复质量。想了解 Cherry Studio 的更多 AI 应用玩法,可以参考 Cherry Studio 接入 Claude API 做 SEO 完整小白教程。

ChatBox 与 Cherry Studio 对比:怎么选?

| 对比项 | ChatBox | Cherry Studio |

|---|---|---|

| 开源免费 | ✅ 开源免费 | ✅ 开源免费 |

| 平台支持 | Win/Mac/Linux/iOS/Android/Web | Win/Mac/Linux |

| 移动端 | ✅ 有 iOS 和 Android | ❌ 仅桌面端 |

| 网页版 | ✅ web.chatboxai.app | ❌ 无 |

| 内置助手 | 少量 | 300+ 预设助手 |

| 知识库 | ✅ 桌面端支持 | ✅ 支持 |

| 文档对话 | ✅ PDF/Word/图片 | ✅ 支持 |

| MCP 集成 | ✅ 支持 | ✅ 支持 |

| 界面语言 | 中英文 | 中文优先 |

| 适合人群 | 全平台用户、需要移动端 | 偏好中文界面、需要丰富预设 |

💡 怎么选? 需要手机上也能用 → ChatBox。偏好中文界面和丰富的内置助手 → Cherry Studio。两个都免费,都试试也不亏。

为什么选 ClaudeAPI.com 而不是官方直连?

| 对比项 | Anthropic 官方 | ClaudeAPI.com |

|---|---|---|

| 国内访问 | ❌ 网络不稳定 | ✅ 国内直连 |

| 支付方式 | 仅海外信用卡 | ✅ 支付宝/微信 |

| 注册门槛 | 需海外手机号 | 国内手机号/邮箱 |

| API 格式 | 仅 Anthropic 格式 | ✅ 同时支持 OpenAI 兼容格式 |

| 计费 | 美元 | ✅ 人民币 |

| 最低充值 | ~$5(约 36 元) | ✅ 5元免费体验 |

对于国内开发者来说,ClaudeAPI.com 是目前接入 Claude API 最简单的方式。更多关于 Claude API 的使用技巧,请参考 用 Claude API 做 SEO 完整指南。

进阶技巧

设置 System Prompt

在对话设置中自定义 System Prompt,让 Claude 扮演特定角色。以下为我们实测使用的 System Prompt:

你是一位资深 Python 开发工程师,擅长代码审查和架构设计。回答简洁。

你是一位资深 Python 开发工程师,擅长代码审查和架构设计。回答简洁。

实测效果:3 轮对话上下文连贯,回答精准简洁,总耗时 22.41s。

控制成本:Claude API 模型选型建议

根据实测数据,不同场景推荐的模型和预估花费:

| 使用场景 | 推荐模型 | 单次预估花费 | 说明 |

|---|---|---|---|

| 日常聊天 | claude-sonnet-4-6 | ~¥0.001-0.01 | 输入少输出短 |

| 代码生成 | claude-sonnet-4-6 | ~¥0.01-0.05 | 中等输出量 |

| 长文写作 | claude-sonnet-4-6 | ~¥0.05-0.1 | 实测 476 Token 约 35 输入 |

| 深度分析 | claude-opus-4-6 | ~¥0.1-0.5 | Opus 单价更高但质量最好 |

| 简单翻译/分类 | claude-haiku-4-5-20251001 | ~¥0.001 | 最便宜最快 |

💡 实测参考:我们用 Sonnet 4.6 生成一篇 478 字的短文(“为什么程序员应该学习 AI”),输入 35 Token + 输出 476 Token,耗时 42.22s。按 ClaudeAPI.com 定价约 ¥0.02。

文档对话

两款客户端都支持上传文档和 Claude 对话:

- 上传 PDF → 让 Claude 总结要点、回答问题

- 上传代码文件 → 让 Claude 做代码审查

- 上传截图 → 让 Claude 分析界面/错误信息

💡 文档对话使用 Claude 的多模态能力,建议使用 Sonnet 4.6 或 Opus 4.6 以获得最佳效果。

常见问题(FAQ)

配置后发消息没反应 / 报错怎么办?

检查清单:

- [ ] Base URL 是否填的

https://gw.claudeapi.com - [ ] API Key 是否完整复制(

sk-开头) - [ ] 模型名称是否正确拼写

- [ ] ClaudeAPI.com 账户是否有余额

提示 “model not found” 或 “invalid model” 怎么办?

模型名称拼写错误。以下为实测通过的完整模型名(区分大小写):

claude-opus-4-6

claude-sonnet-4-6

claude-haiku-4-5-20251001

claude-sonnet-4-5-20250929

claude-sonnet-4-20250514

claude-opus-4-6

claude-sonnet-4-6

claude-haiku-4-5-20251001

claude-sonnet-4-5-20250929

claude-sonnet-4-20250514

Claude API 回复速度慢怎么办?

实测参考速度(简单 Prompt,200 Token 输出):

| 模型 | 实测耗时 |

|---|---|

| Haiku 4.5 | 4.03s(最快) |

| Sonnet 4.5 | 4.63s |

| Sonnet 4 | 6.85s |

| Opus 4.6 | 7.01s |

| Sonnet 4.6 | 8.35s |

如果明显慢于以上数据,检查网络连接。长文本生成(500+ Token)耗时 30-50s 属正常。

Cherry Studio 里看不到模型怎么办?

添加完服务商后,需要手动添加模型。在服务商配置中点「添加模型」,手动输入模型 ID(如 claude-sonnet-4-6)。

支持流式输出吗?

支持。实测 Streaming 正常工作:

- 首 Token 延迟:5.38s(Sonnet 4.6)

- 回复逐字显示,分 13 个 Chunk 输出

ChatBox 和 Cherry Studio 默认开启流式输出。

ChatBox / Cherry Studio 接入 Claude API 麻烦吗?

不麻烦,三分钟搞定。 通过 ClaudeAPI.com 提供的国内直连地址(https://claudeapi.com),在国内网络环境下即可正常使用。

测试代码参考

如果你想在配置客户端之前先用代码验证 Key 是否可用

from openai import OpenAI

client = OpenAI(

api_key="sk-你的Key",

base_url="https://gw.claudeapi.com"

)

# 基础测试

response = client.chat.completions.create(

model="claude-sonnet-4-6",

messages=[{"role": "user", "content": "你好,用一句话介绍你自己"}],

max_tokens=100

)

print(response.choices[0].message.content)

# 流式测试

stream = client.chat.completions.create(

model="claude-sonnet-4-6",

messages=[{"role": "user", "content": "Python 有什么优点?"}],

max_tokens=200,

stream=True

)

for chunk in stream:

if chunk.choices and chunk.choices[0].delta.content:

print(chunk.choices[0].delta.content, end="", flush=True)

from openai import OpenAI

client = OpenAI(

api_key="sk-你的Key",

base_url="https://gw.claudeapi.com"

)

# 基础测试

response = client.chat.completions.create(

model="claude-sonnet-4-6",

messages=[{"role": "user", "content": "你好,用一句话介绍你自己"}],

max_tokens=100

)

print(response.choices[0].message.content)

# 流式测试

stream = client.chat.completions.create(

model="claude-sonnet-4-6",

messages=[{"role": "user", "content": "Python 有什么优点?"}],

max_tokens=200,

stream=True

)

for chunk in stream:

if chunk.choices and chunk.choices[0].delta.content:

print(chunk.choices[0].delta.content, end="", flush=True)

💡 想用 Claude API 做更复杂的开发?请参考 Claude Code 国内接入教程。

总结:3 分钟接入 Claude API

无需写代码,国内直连,3 分钟就能在桌面客户端用上 Claude:

| 步骤 | 操作 |

|---|---|

| 1. 获取 Key | (https://gw.claudeapi.com) 注册 → 充值 → 创建令牌→获取Key |

| 2. 下载客户端 | ChatBox 或 Cherry Studio |

| 3. 配置 API | Provider 选 OpenAI 兼容/Anthropic,Base URL 填 https://gw.claudeapi.com,填入你的Key |

| 4. 选模型 | 填入 claude-sonnet-4-6(推荐),开始对话 |

配置速查卡

Base URL: https://gw.claudeapi.com

API Key: sk-...

模型推荐: claude-sonnet-4-6(日常) / claude-haiku-4-5-20251001(快+便宜)

Base URL: https://gw.claudeapi.com

API Key: sk-...

模型推荐: claude-sonnet-4-6(日常) / claude-haiku-4-5-20251001(快+便宜)

实测结论

- ✅ 5 个 Claude 模型全部通过测试

- ✅ 流式输出正常(首 Token 5.38s)

- ✅ 多轮对话上下文连贯(3 轮 22.41s)

- ✅ 长文本生成正常(478 字 42.22s)

👉 立即前往(https://claudeapi.com) 获取 API Key,让 Claude 成为你的桌面 AI 助手。

本文由 ClaudeAPI.com 技术团队撰写,所有数据均为 2026 年实测。如有疑问,请访问 ClaudeAPI.com 获取帮助。